百度又有“大動(dòng)作”?9月18日,百度正式公布在圖神經(jīng)網(wǎng)絡(luò)領(lǐng)域取得新突破,提出融合標(biāo)簽傳遞和圖神經(jīng)網(wǎng)絡(luò)的統(tǒng)一模型 UniMP(Unified Message Passing),在圖神經(jīng)網(wǎng)絡(luò)權(quán)威榜單 OGB(Open Graph Benchmark)取得多項(xiàng)榜首,引發(fā)業(yè)界關(guān)注。

Leaderboard for ogbn-products

Leaderboard for ogbn-proteins

Leaderboard for ogbn-arxiv

圖神經(jīng)網(wǎng)絡(luò)最權(quán)威榜單 OGB

圖神經(jīng)網(wǎng)絡(luò)是用于圖結(jié)構(gòu)數(shù)據(jù)的深度學(xué)習(xí)架構(gòu),將端到端學(xué)習(xí)與歸納推理相結(jié)合,有望解決傳統(tǒng)深度學(xué)習(xí)無法處理的因果推理、可解釋性等問題,是非常有潛力的人工智能研究方向。但是,這個(gè)領(lǐng)域一直缺乏規(guī)模比較大且認(rèn)可度較高的數(shù)據(jù)集。目前大量的論文仍然在 Cora、PubMed、Citeseer 等小數(shù)據(jù)集上進(jìn)行實(shí)驗(yàn),實(shí)驗(yàn)的效果也沒有普適性。在此情況下,OGB(Open Graph Benchmark)應(yīng)運(yùn)而生:

權(quán)威性高:OGB 是由斯坦福大學(xué)圖神經(jīng)網(wǎng)絡(luò)權(quán)威 Jure Leskovec 教授團(tuán)隊(duì)建立的大規(guī)模圖學(xué)習(xí)任務(wù)的評(píng)測(cè)基準(zhǔn)數(shù)據(jù)集,指導(dǎo)委員會(huì)包含 Yoshua Bengio、Will Hamilton、Max Welling 等業(yè)界大牛。Jure Leskovec 教授在 NeurlPS 2019大會(huì)的演講中正式對(duì)外發(fā)布 OGB 并開源,是目前公認(rèn)最權(quán)威的圖學(xué)習(xí)相關(guān)基準(zhǔn)測(cè)試數(shù)據(jù)集。

數(shù)據(jù)豐富:OGB 面向不同的圖學(xué)習(xí)任務(wù)(包括節(jié)點(diǎn)分類,邊預(yù)測(cè),圖分類)分別提供了多個(gè)數(shù)據(jù)集,如學(xué)術(shù)引用網(wǎng)絡(luò)、知識(shí)圖譜、分子圖、生物網(wǎng)絡(luò)等。其中最熱門的三個(gè)半監(jiān)督節(jié)點(diǎn)分類數(shù)據(jù)集:商品推薦 ogbn-products、論文引用 ogbn-arxiv 和化學(xué)分子 ogbn-proteins,對(duì)圖神經(jīng)網(wǎng)絡(luò)研究者有極強(qiáng)的吸引力。

奪榜激烈:OGB 吸引了包括斯坦福、紐約大學(xué)、加州大學(xué)洛杉磯分校、康奈爾大學(xué)、亞馬遜等多個(gè)機(jī)構(gòu)參與打榜;榜單上也誕生了層出不窮的新穎圖神經(jīng)網(wǎng)絡(luò)結(jié)構(gòu),如堆積112層的深度圖卷積網(wǎng)絡(luò) DeeperGCN,發(fā)表在 ICML 2020的多層圖網(wǎng)絡(luò) GCNII,還有多種形式不同的圖采樣算法。

近日,百度 PGL 團(tuán)隊(duì)創(chuàng)新提出統(tǒng)一消息傳遞圖神經(jīng)網(wǎng)絡(luò)模型 UniMP,在三大半監(jiān)督節(jié)點(diǎn)分類數(shù)據(jù)集均榮登榜首。榜單上放出的開源代碼與論文地址如下:

UniMP開源代碼地址

https://github.com/PaddlePadd...

UniMP論文地址

https://arxiv.org/pdf/2009.03...

UniMP:統(tǒng)一消息傳遞模型

在半監(jiān)督圖節(jié)點(diǎn)分類場(chǎng)景下,節(jié)點(diǎn)之間通過邊相連接,部分節(jié)點(diǎn)被打上標(biāo)簽。任務(wù)要求模型通過監(jiān)督學(xué)習(xí)的方式,擬合被標(biāo)注節(jié)點(diǎn)數(shù)據(jù),并對(duì)未標(biāo)注的節(jié)點(diǎn)進(jìn)行預(yù)測(cè)。如下圖所示,在一般機(jī)器學(xué)習(xí)的問題上,已標(biāo)注的訓(xùn)練數(shù)據(jù)在新數(shù)據(jù)的推斷上,并不能發(fā)揮直接的作用,因?yàn)閿?shù)據(jù)的輸入是獨(dú)立的。然而在圖神經(jīng)網(wǎng)絡(luò)的場(chǎng)景下,已有的標(biāo)注數(shù)據(jù)可以從節(jié)點(diǎn)與節(jié)點(diǎn)的連接中,根據(jù)圖結(jié)構(gòu)關(guān)系推廣到新的未標(biāo)注數(shù)據(jù)中。

一般應(yīng)用于半監(jiān)督節(jié)點(diǎn)分類的算法分為圖神經(jīng)網(wǎng)絡(luò)和標(biāo)簽傳遞算法兩類,它們都是通過消息傳遞的方式(前者傳遞特征、后者傳遞標(biāo)簽)進(jìn)行節(jié)點(diǎn)標(biāo)簽的學(xué)習(xí)和預(yù)測(cè)。其中經(jīng)典標(biāo)簽傳遞算法如 LPA,只考慮了將標(biāo)簽在圖上進(jìn)行傳遞,而圖神經(jīng)網(wǎng)絡(luò)算法大多也只是使用了節(jié)點(diǎn)特征以及圖的鏈接信息進(jìn)行分類。但是單純考慮標(biāo)簽傳遞或者節(jié)點(diǎn)特征都是不足夠的。

百度 PGL 團(tuán)隊(duì)提出的統(tǒng)一消息傳遞模型 UniMP,將上述兩種消息統(tǒng)一到框架中,同時(shí)實(shí)現(xiàn)了節(jié)點(diǎn)的特征與標(biāo)簽傳遞,顯著提升了模型的泛化效果。UniMP 以 Graph Transformer 模型作為基礎(chǔ)骨架,聯(lián)合使用標(biāo)簽嵌入方法,將節(jié)點(diǎn)特征和部分節(jié)點(diǎn)標(biāo)簽同時(shí)輸入至模型中,從而實(shí)現(xiàn)了節(jié)點(diǎn)特征和標(biāo)簽的同時(shí)傳遞。

簡單的加入標(biāo)簽信息會(huì)帶來標(biāo)簽泄漏的問題,即標(biāo)簽信息即是特征又是訓(xùn)練目標(biāo)。實(shí)際上,標(biāo)簽大部分是有順序的,例如在引用網(wǎng)絡(luò)中,論文是按照時(shí)間先后順序出現(xiàn)的,其標(biāo)簽也應(yīng)該有一定的先后順序。在無法得知訓(xùn)練集標(biāo)簽順序的情況下,UniMP 提出了標(biāo)簽掩碼學(xué)習(xí)方法。UniMP 每一次隨機(jī)將一定量的節(jié)點(diǎn)標(biāo)簽掩碼為未知,用部分已有的標(biāo)注信息、圖結(jié)構(gòu)信息以及節(jié)點(diǎn)特征來還原訓(xùn)練數(shù)據(jù)的標(biāo)簽。最終,UniMP 在 OGB 上取得 SOTA 效果,并在論文的消融實(shí)驗(yàn)上,驗(yàn)證了方法的有效性。

屠榜背后:飛槳圖學(xué)習(xí)框架 PGL 加持

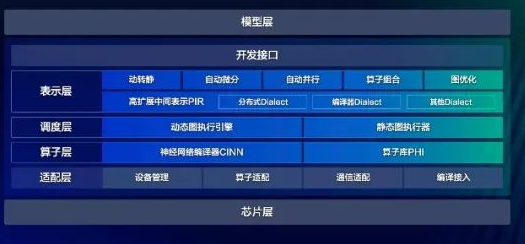

UniMP 基于飛槳圖學(xué)習(xí)框架 PGL(Paddle Graph Learning)實(shí)現(xiàn),依托飛槳核心框架以及自研的圖引擎。PGL 支持十億節(jié)點(diǎn)百億邊的超巨圖訓(xùn)練,原生支持異構(gòu)圖 Metapath 采樣以及 Message Passing 雙模式,預(yù)置多種業(yè)界主流圖學(xué)習(xí)算法以及自研模型如 ERNIESage、UniMP 等,方便開發(fā)者熟悉和使用圖神經(jīng)網(wǎng)絡(luò)領(lǐng)域模型。

飛槳 PGL 已經(jīng)在搜索、廣告、信息流、金融風(fēng)控、貼吧、用戶畫像、智能地圖等場(chǎng)景全面落地,可支持百億巨圖場(chǎng)景。圖學(xué)習(xí)作為通用人工智能算法之一,勢(shì)必成為這個(gè)時(shí)代新的基礎(chǔ)設(shè)施,賦能各行各業(yè),助燃智能經(jīng)濟(jì)騰飛。

PGL 獲得喜人成績,背后離不開強(qiáng)有力的后盾——飛槳。飛槳是我國首個(gè)開源開放、功能完備的產(chǎn)業(yè)級(jí)深度學(xué)習(xí)平臺(tái),向下對(duì)接芯片,能夠和芯片進(jìn)行軟硬一體的優(yōu)化,向上支撐各種應(yīng)用,助力技術(shù)創(chuàng)新和業(yè)務(wù)發(fā)展,可以說是“智能時(shí)代的操作系統(tǒng)”。近期,飛槳?jiǎng)討B(tài)圖和 API 體系全面升級(jí),讓開發(fā)者可以更便捷地開發(fā)、更高效地部署模型。

百度希望有志之士加入 PGL,一起共建未來。PGL 代碼完全開源開放,歡迎歡迎開發(fā)者們使用并貢獻(xiàn)您的奇思妙想。如果您覺得還不錯(cuò),歡迎“Star”;如果您有意見需要交流,歡迎“Issue”,PGL 開源代碼和入門教程鏈接:

PGL 開源代碼

https://github.com/PaddlePadd...

圖學(xué)習(xí)入門教程

https://aistudio.baidu.com/ai...

審核編輯:符乾江

-

百度

+關(guān)注

關(guān)注

9文章

2377瀏覽量

94934 -

人工智能

+關(guān)注

關(guān)注

1817文章

50105瀏覽量

265551

發(fā)布評(píng)論請(qǐng)先 登錄

百度正式發(fā)布并開源新一代文檔解析模型PaddleOCR-VL-1.5

神經(jīng)網(wǎng)絡(luò)的初步認(rèn)識(shí)

CNN卷積神經(jīng)網(wǎng)絡(luò)設(shè)計(jì)原理及在MCU200T上仿真測(cè)試

NMSIS神經(jīng)網(wǎng)絡(luò)庫使用介紹

在Ubuntu20.04系統(tǒng)中訓(xùn)練神經(jīng)網(wǎng)絡(luò)模型的一些經(jīng)驗(yàn)

液態(tài)神經(jīng)網(wǎng)絡(luò)(LNN):時(shí)間連續(xù)性與動(dòng)態(tài)適應(yīng)性的神經(jīng)網(wǎng)絡(luò)

神經(jīng)網(wǎng)絡(luò)的并行計(jì)算與加速技術(shù)

商湯日日新V6.5多模態(tài)大模型登頂全球權(quán)威榜單

百度地圖重磅發(fā)布地圖AI開放平臺(tái)

云知聲再度登頂MedBench榜單

上汽大眾與百度地圖達(dá)成戰(zhàn)略合作

百度AI榮獲2025愛迪生獎(jiǎng)金獎(jiǎng)和銀獎(jiǎng)

百度地圖與雅迪推出組合屏智能導(dǎo)航解決方案

百度飛槳框架3.0正式版發(fā)布

百度飛槳登頂圖神經(jīng)網(wǎng)絡(luò)權(quán)威榜單3項(xiàng)榜首,重磅推出UniMP

百度飛槳登頂圖神經(jīng)網(wǎng)絡(luò)權(quán)威榜單3項(xiàng)榜首,重磅推出UniMP

評(píng)論