本教程的目標:

了解什么是音高 (Pitch) 以及歷史上機器學習如何檢測歌曲中的音高

對歌曲數(shù)據(jù)以及執(zhí)行模型的結果進行可視化

編寫通過手機麥克風收集聲音的代碼

在 Android 應用程序內(nèi)部部署 ML 模型

對歌曲的數(shù)據(jù)進行轉換并使用 SPICE 模型進行推斷

在 Android 手機屏幕上呈現(xiàn)最終結果

介紹

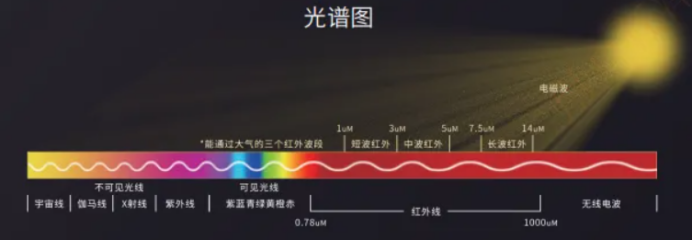

音高是聲音的一種感知屬性,可以按相應的頻率對其進行排序。換句話說,音高在音樂旋律中是用來判斷聲音聽起來“高”和“低”的一種屬性。音高是音調(diào)的主要聽覺屬性之一,其余為音長 (Duration),音強 (Loudness),以及音色 (Timbre)。音高通過頻率進行量化,并以赫茲 (Hz) 為單位進行測量,其中 1Hz 表示每秒一個周期。

音高檢測 (Pitch detection) 一個有趣的挑戰(zhàn)。歷史上,對音高和音高感知的研究一直是心理聲學的核心問題,并且在音頻表征的形成與測試理論、 信號處理算法 (Signal-Processing Algorithms) 以及聽覺系統(tǒng)中的感知等方面起到重要作用。研究人員為此開發(fā)并應用了許多技術 ,還努力將相近頻率的背景噪聲與背景音樂進行分離。

技術

https://www.cs.uregina.ca/Research/Techreports/2003-06.pdf

今天,我們可以通過機器學習來實現(xiàn)這一目標,更具體地說,可以使用 SPICE 模型。這是一個經(jīng)過預訓練的模型,可以識別混合錄制的音頻中的基本音高(包括噪音和背景音樂),您可以在 TensorFlow Hub 獲取 SPICE 模型,包括適用于 Web 端的 TensorFlow.js 以及適用于移動端的 TensorFlow Lite。

TensorFlow Hub

https://tfhub.dev/

TensorFlow.js

https://tfhub.dev/google/tfjs-model/spice/1/default/1

TensorFlow Lite

https://tfhub.dev/google/lite-model/spice/1

開始

音頻以單聲道 16khz 采樣率記錄并保存為 .wav 格式。讓我們用一個具有該格式的簡單音頻文件為例。如果使用對數(shù)頻率坐標圖(以使歌聲更清晰可見),加載它并可視化輸出,我們將獲得一個頻譜圖,該頻譜圖顯示隨時間變化的頻率:

音頻文件

https://storage.googleapis.com/download.tensorflow.org/data/c-scale-metronome.wav

在執(zhí)行帶有歌曲數(shù)據(jù)的模型后,我們將打印模型的輸出。藍色表示模型預測的音高值,橙色表示這些音高值的置信度:

如果僅保留置信度大于 90% 的結果,并將其與灰度圖重疊,我們將獲得下圖:

在所有長度的歌曲上準確性都很高!!

需要指出的是,雖然對于上述示例,基于頻譜圖的啟發(fā)式音高提取方法可能也起作用。但是通常情況下,基于機器學習的模型會優(yōu)于手工提取的信號處理方法,特別是當音頻中存在背景噪聲和背景音樂時。關于 SPICE 與 SWIPE(基于頻譜圖的算法)的比較,請參見此文。

若在 Android 應用程序內(nèi)部運行 SPICE 模型,必須使用麥克風收集聲音。首先,我們設置變量:

private val AUDIO_SOURCE = MediaRecorder.AudioSource.VOICE_RECOGNITION private val SAMPLE_RATE = 16000 private val CHANNEL_MASK = AudioFormat.CHANNEL_IN_MONO private val ENCODING = AudioFormat.ENCODING_PCM_16BIT private val BUFFER_SIZE = AudioRecord.getMinBufferSize(SAMPLE_RATE, CHANNEL_MASK, ENCODING) private val AUDIO_FORMAT = AudioFormat.Builder().setEncoding(ENCODING) .setSampleRate(SAMPLE_RATE) .setChannelMask(CHANNEL_MASK) .build()

然后,選擇 MediaRecorder.AudioSource.VOICE_RECOGNITION 以將麥克風聲源導入至語音識別并應用噪聲消除。音頻格式是 16位,單聲道,16KHz 采樣率的理想格式。最后,我們開始錄音進程:

/** * Start the recording process. */ mRecorder = AudioRecord.Builder().setAudioSource(AUDIO_SOURCE) .setAudioFormat(AUDIO_FORMAT) .setBufferSizeInBytes(BUFFER_SIZE) .build() mRecorder?.startRecording()

停止錄音進程 mRecorder.stopRecording() ,隨后我們從錄音機流中讀取音頻:

private val readAudio = Runnable { var readBytes: Int buffer = ShortArray(BUFFER_SIZE) while (mRecording) { readBytes = mRecorder!!.read(buffer, 0, BUFFER_SIZE) //Higher volume of microphone //https://stackoverflow.com/questions/25441166/how-to-adjust-microphone-sensitivity-while-recording-audio-in-android if (readBytes > 0) { for (i in 0 until readBytes) { buffer[i] = Math.min( (buffer[i] * 6.7).toInt(), Short.MAX_VALUE.toInt() ).toShort() } } if (readBytes != AudioRecord.ERROR_INVALID_OPERATION) { for (s in buffer) { // Add all values to arraylist bufferForInference.add(s) writeShort(mPcmStream, s) } } } }

注意此處的乘法 buffer[i] * 6.7。這個參數(shù)用于控制麥克風增益并提高靈敏度(您可以使用其他值代替 6.7 來滿足需要)!

在此類內(nèi),還有一個將字節(jié)數(shù)組轉換為.wav文件的函數(shù)。該文件存儲在手機內(nèi)部存儲器的Pitch Detector文件夾中,可用于與原始版本對比驗證移動端模型輸出的準確性。

原始版本

https://colab.sandbox.google.com/github/tensorflow/hub/blob/master/examples/colab/spice.ipynb

部署 SPICE 模型的第一步是復制位于 Assets 文件夾中的 .tflite 文件。我們將這些依賴包含在 app build.gradle 文件中:

implementation 'org.tensorflow0.0.0-nightly' implementation 'org.tensorflow0.0.0-nightly' implementation 'org.tensorflow0.0.0-nightly'

.tflite 文件

https://tfhub.dev/google/lite-model/spice/1

最后一個依賴項含有額外的算子——這是該項目不可或缺的依賴項,但會顯著增大最終 .apk 文件的體積,因為該模型使用了一些在第一個 tflite 依賴項中沒有的算子。如需進一步了解,您可以閱讀此文。

此文

https://tensorflow.google.cn/lite/guide/ops_select#android_aar

初始化解釋器,從文件夾加載模型文件:

// load tflite file from assets folder @Throws(IOException::class) private fun loadModelFile(context: Context, modelFile: String): MappedByteBuffer { val fileDescriptor = context.assets.openFd(modelFile) val inputStream = FileInputStream(fileDescriptor.fileDescriptor) val fileChannel = inputStream.channel val startOffset = fileDescriptor.startOffset val declaredLength = fileDescriptor.declaredLength val retFile = fileChannel.map(FileChannel.MapMode.READ_ONLY, startOffset, declaredLength) fileDescriptor.close() return retFile } @Throws(IOException::class) private fun getInterpreter( context: Context, modelName: String, useGpu: Boolean ): Interpreter { val tfliteOptions = Interpreter.Options() if (useGpu) { gpuDelegate = GpuDelegate() tfliteOptions.addDelegate(gpuDelegate) } tfliteOptions.setNumThreads(numberThreads) return Interpreter(loadModelFile(context, modelName), tfliteOptions) }

我們準備好了,使用音頻流進行推理!

音頻流采用 ArrayList

fun execute(floatsInput: FloatArray): ArrayList

當我們獲得結果后,我們接下來要做的是:

篩選輸出置信度超過 90% 的結果

將絕對音高轉換為赫茲 (Hz)

計算唱歌期間的偏移量

使用一些啟發(fā)式算法嘗試預測并輸出最可能的演唱樂譜。

上述步驟中,計算出理想的偏移量是重要的一步,因為通常人們哼唱的旋律與可以記譜的絕對音高值之間存在偏移。為此,我們還需要知道歌曲的速度(這樣才能確定采用的音符長度,比如八分音符)以及開始量化產(chǎn)生音符的時間偏移量。為簡單起見,我們將嘗試使用不同的速度和時間偏移并測量量化誤差,最后采用該誤差最小的組合。您可以在 PitchModelExecutor.kt 的源代碼中繼續(xù)深入了解。

PitchModelExecutor.kt 的源代碼

https://github.com/farmaker47/Pitch_Estimator/blob/master/app/src/main/java/com/george/pitch_estimator/PitchModelExecutor.kt

通過上述過程,我們獲得了含有音符字符串的 ArrayList,例如 [A2,F(xiàn)2,G#2,C3],這些結果顯示在屏幕上。

TensorFlow Hub 的 SPICE 模型示例頁面有一個出色的可視化工具,可以在靜態(tài)的五線譜上顯示不斷流入的音符。因此,是時候在我們的移動應用程序去中復制此實時效果了!

可視化工具

https://tfhub.dev/google/lite-model/spice/1

Android webview 用于處理一些自定義 html 代碼。我們將此代碼加載到綁定適配器中:

// this binding adapter helps load custom html from assets folder @BindingAdapter("htmlToScreen") fun bindTextViewHtml(webView: WebView, htmlValue: String) { webView.settings.javaScriptEnabled = true webView.loadDataWithBaseURL("fake://not/needed", htmlValue, "text/html", "UTF-8", "") }

您可以在 這個 GitHub Gist 找到提供給 Webview 的 html 源代碼!

GitHub Gist

https://gist.github.com/farmaker47/8e3b6a5af795f32459d35d2198f07d1c

當屏幕上顯示如 [A2,F(xiàn)2] 這樣的文字音符時,我們執(zhí)行:

// Observe notes as they come out of model and update webview respectively viewModel.noteValuesToDisplay.observe(viewLifecycleOwner, androidx.lifecycle.Observer { list -> if (list.size > 0) { var i = 0 val handler = Handler() handler.post(object : Runnable { override fun run() { when (list[i]) { "C2" -> binding.webView.loadUrl("javascript:myMove('125')") "C#2" -> binding.webView.loadUrl("javascript:myMoveSharp('125')") "D2" -> binding.webView.loadUrl("javascript:myMove('130')") "D#2" -> binding.webView.loadUrl("javascript:myMoveSharp('130')") "E2" -> binding.webView.loadUrl("javascript:myMove('135')") "F2" -> binding.webView.loadUrl("javascript:myMove('140')") "F#2" -> binding.webView.loadUrl("javascript:myMoveSharp('140')") "G2" -> binding.webView.loadUrl("javascript:myMove('145')") "G#2" -> binding.webView.loadUrl("javascript:myMoveSharp('145')") "A2" -> binding.webView.loadUrl("javascript:myMove('150')") "A#2" -> binding.webView.loadUrl("javascript:myMoveSharp('150')") "B2" -> binding.webView.loadUrl("javascript:myMove('155')") ........................... } i++ if (i < list.size) { handler.postDelayed(this, 555L) } } }) } })

在這里,我們每兩秒鐘觀察一次音符變化,對于列表中的每個音符,我們執(zhí)行 javascript 函數(shù)。myMove 函數(shù)內(nèi)部的值是注釋的垂直偏移量。

此項目的 GitHub 地址(https//github.com/farmaker47/Pitch_Estimator)。

此項目使用 Kotlin 語言,并且包括:

使用 Webview 和自定義 HTML 加載。

使用 TensorFlow 的 .tflite 模型文件:

數(shù)據(jù)綁定

MVVM 模式下的協(xié)程

Koin DI

改進計劃

在應用程序的 build.gradle 文件中,我們添加了特殊算子的依賴項:

implementation ‘org.tensorflow0.0.0-nightly’

此依賴項導致最終的 .apk 文件體積膨脹。我們計劃通過僅選擇模型所需的算子,以此減少最終 .apk 的大小。

通過改進算法,我們將能夠查看全音符,二分音符,休止符和其他音符。

責任編輯:lq

-

音頻

+關注

關注

31文章

3188瀏覽量

85579 -

機器學習

+關注

關注

66文章

8553瀏覽量

136954 -

tensorflow

+關注

關注

13文章

334瀏覽量

62187

原文標題:學習教程 | 用 TensorFlow Lite 和 SPICE 模型打造聽歌識譜 App

文章出處:【微信號:tensorflowers,微信公眾號:Tensorflowers】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

小鵬汽車正式加入荷蘭出行行業(yè)企業(yè)協(xié)會

機器學習和深度學習中需避免的 7 個常見錯誤與局限性

穿孔機頂頭檢測儀 機器視覺深度學習

Shell歷史命令history用法

Linux歷史上10件最有意義的大事,你知道幾件?

機器視覺檢測PIN針

創(chuàng)造歷史,芯和半導體成為首家獲得工博會CIIF大獎的國產(chǎn)EDA

博世80億美元收購美國江森自控(Johnson Controls)暖通空調(diào)(HVAC)業(yè)務!博世歷史上最大收購

FPGA在機器學習中的具體應用

機器學習異常檢測實戰(zhàn):用Isolation Forest快速構建無標簽異常檢測系統(tǒng)

【「# ROS 2智能機器人開發(fā)實踐」閱讀體驗】視覺實現(xiàn)的基礎算法的應用

【「# ROS 2智能機器人開發(fā)實踐」閱讀體驗】+ROS2應用案例

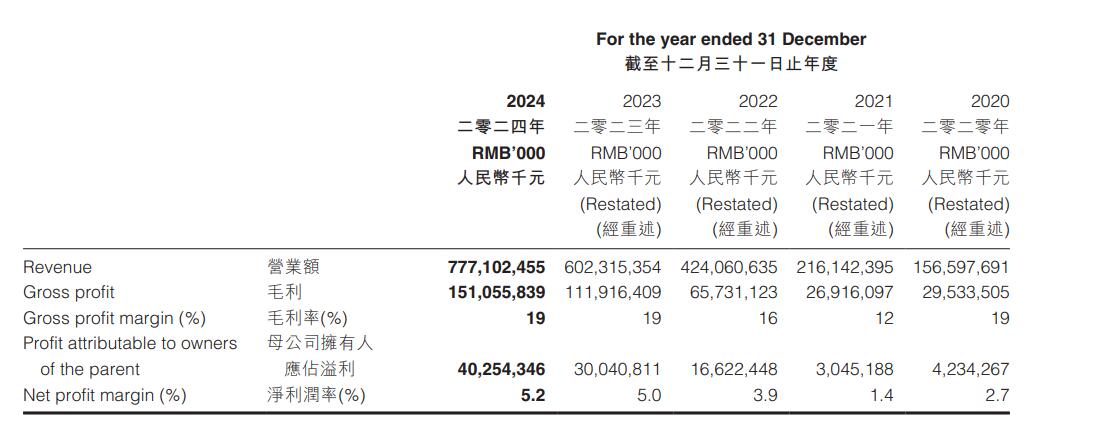

日賺1.1億,營收超特斯拉!比亞迪史上最強財報兩大看點

史上最強財報!小米2024年營收飆漲35%,2025年汽車交付超35萬輛

了解什么是音高以及歷史上機器學習如何檢測歌曲中的音高

了解什么是音高以及歷史上機器學習如何檢測歌曲中的音高

評論