AI在藝術(shù)界表現(xiàn)出越來(lái)越驚人的“天賦”

我們知道用AI來(lái)繪畫(huà)、寫(xiě)詩(shī)、作曲已經(jīng)不是新鮮事。但在藝術(shù)領(lǐng)域,AI在試圖模仿、甚至超越人類(lèi)的過(guò)程中,始終存在一個(gè)難以逾越的瓶頸,就是人類(lèi)與生而來(lái)的創(chuàng)造力。

這也是AI研發(fā)人員聚焦深度學(xué)習(xí)和強(qiáng)化學(xué)習(xí)著力攻克的難點(diǎn)之一。

近日,預(yù)印論文庫(kù)arXiv上發(fā)表了一項(xiàng)最新研究成果,論文中的AI畫(huà)家可以化身“心靈捕手”,通過(guò)對(duì)話式溝通感受人類(lèi)的獨(dú)特品質(zhì)、個(gè)性和情緒,從而繪制具備內(nèi)在情感特征的人物肖像。

據(jù)了解,這位Empathic AI Painter,出自來(lái)自加拿大溫哥華西蒙弗雷澤大學(xué)(SFU)iViz實(shí)驗(yàn)室團(tuán)隊(duì)。此前,他們的AI畫(huà)家曾在國(guó)際神經(jīng)信息處理系統(tǒng)(NeurIPS)大會(huì)做了現(xiàn)場(chǎng)演示,吸引眾多用戶(hù)參與圍觀,還受到CTV國(guó)家新聞的專(zhuān)項(xiàng)報(bào)道。

那么這款“心靈捕手”AI畫(huà)家是如何進(jìn)行藝術(shù)創(chuàng)作的呢?

會(huì)聊天的AI畫(huà)家

據(jù)該團(tuán)隊(duì)介紹,AI畫(huà)家具備兩套創(chuàng)意系統(tǒng),一是對(duì)話式語(yǔ)音交互系統(tǒng),一是AI人像生成模型系統(tǒng),他們均通過(guò)3D虛擬人像來(lái)呈現(xiàn)。

Empathic AI Painter

與傳統(tǒng)繪制畫(huà)像不同,它不是一種靜態(tài)的“眼觀”模式,而是采取對(duì)話聊天的形式,捕捉內(nèi)在情緒完成藝術(shù)創(chuàng)作。

該團(tuán)隊(duì)教授史蒂夫·迪帕拉( DiPaola)表示,3D虛擬畫(huà)家的語(yǔ)音交互系統(tǒng)可以與用戶(hù)聊天,就某一事件采訪他們的感受,了解他們的性格,進(jìn)而通過(guò)AI人像生成模型,在繪畫(huà)過(guò)程中體現(xiàn)不同的情感特質(zhì)。總的來(lái)說(shuō),AI畫(huà)家需要完成三項(xiàng)任務(wù):

感知用戶(hù)語(yǔ)言和行為

基于以上信息,判定人物性格和情感特質(zhì);

通過(guò)AI人像生成模型,在繪畫(huà)風(fēng)格、色彩、紋理上呈現(xiàn)不同的用戶(hù)特質(zhì);

在ECA方面,3D虛擬人像融合了NLP自然語(yǔ)言處理模型,在交談中通過(guò)面部情感、語(yǔ)言壓力、語(yǔ)義,感知人類(lèi)的情感和對(duì)話,并作出相應(yīng)的反饋。另外,其內(nèi)置的共情建模,還可以通過(guò)手勢(shì)、言語(yǔ)、表情,對(duì)用戶(hù)情緒作出感知性反應(yīng)。自然、真誠(chéng)的對(duì)話表現(xiàn)可以讓人類(lèi)更真實(shí)的表現(xiàn)自己。

在個(gè)人特質(zhì)評(píng)估方面,研究人員采用了“五大人格模型”(FFM)。它是由科斯塔和麥克雷在20世紀(jì)80年代提出的,被廣泛用于人格分析。模型提出了神經(jīng)質(zhì)(N)、外傾性(E)、經(jīng)驗(yàn)開(kāi)放性(O)、宜人性(A)和認(rèn)真性(C)五大人格因素,并通過(guò)NEO人格調(diào)查表進(jìn)行測(cè)量。

在肖像渲染階段,利用mDD((ModifiedDeep Dream)模型在16萬(wàn)張數(shù)據(jù)集上進(jìn)行深度訓(xùn)練,由ePainterly模塊完成的最終的風(fēng)格繪制。

17種不同類(lèi)型的情感肖像

那么它的作畫(huà)效果如何呢?之前提到,AI畫(huà)家曾在NeurIPS 2019大會(huì)上做過(guò)現(xiàn)場(chǎng)展示,當(dāng)時(shí)有26位用戶(hù)參與,并完成的現(xiàn)場(chǎng)交互。實(shí)際上原、人格調(diào)查表有120多個(gè)問(wèn)題,大約需要45分鐘才能完成。

但這里研究人員僅使用了每個(gè)維度的一個(gè)問(wèn)題進(jìn)行了互動(dòng),用時(shí)不足5分鐘。以下是圍繞“會(huì)議感受”主題下的互動(dòng)問(wèn)題:

最終結(jié)果顯示,84.72%的用戶(hù)語(yǔ)音被準(zhǔn)確識(shí)別,AI畫(huà)家完成呈現(xiàn)除了17中不同的個(gè)性類(lèi)別,同時(shí)用戶(hù)也表示,該風(fēng)格表現(xiàn)出了其內(nèi)在的情感特征。(以下是部分作品)

目前這款3D虛擬畫(huà)家的繪畫(huà)作品以已在去全球展出,包括紐約市和惠特尼的現(xiàn)代藝術(shù)博物館(MoMA)。

DiPaola教授認(rèn)為,AI在激發(fā)藝術(shù)與高級(jí)計(jì)算機(jī)技術(shù)融合方面存在無(wú)限的潛力。他們所研發(fā)的AI系統(tǒng)只是藝術(shù)創(chuàng)新的第一步,之后他們還將在此系統(tǒng)上,探索基于詩(shī)歌、散文的藝術(shù)創(chuàng)作。

背后的技術(shù)原理

與傳統(tǒng)AI設(shè)計(jì)使用單一算法不同,DiPaola教授團(tuán)隊(duì)的AI系統(tǒng)融合多種不同的技術(shù)。我們先來(lái)看一下完成的AI系統(tǒng)的架構(gòu)組成,分為對(duì)話交互循環(huán)(Conversational Interaction Loop)和生成風(fēng)格化肖像(Generative Portrait stylization)兩大模塊組成,這兩個(gè)模塊之間由BIG-5人格模型鏈接,用于傳達(dá)個(gè)性化肖像的關(guān)鍵信息。

第一階段的對(duì)話交互循環(huán)功能是基于具有移情模塊的M-Path系統(tǒng)實(shí)現(xiàn)的。它可以呈現(xiàn)出3D虛擬人像的形式。在與人類(lèi)的對(duì)話中,具備類(lèi)似視頻會(huì)議的輸入輸出設(shè)置,能夠根據(jù)用戶(hù)的情感和語(yǔ)言屬性實(shí)時(shí)處理輸入,進(jìn)而產(chǎn)生言語(yǔ)或行為的移情輸出。具體來(lái)說(shuō),M-Path系統(tǒng)的運(yùn)行是基于三個(gè)不同模塊控制:

感知模塊:用于采集和處理參與者信息。當(dāng)用戶(hù)講話時(shí),此模塊通過(guò)麥克風(fēng)和攝像機(jī)收集音頻和視頻作為輸入信號(hào)。在視頻輸入源中,面部情感識(shí)別模塊采用的是OpenCV算法,用來(lái)識(shí)別不同面部表情所對(duì)應(yīng)的情緒類(lèi)別。本次研究中將基本情緒分為6種,憤怒,厭惡,恐懼,喜悅,悲傷,驚奇和蔑視,這一分類(lèi)是基于CK+數(shù)據(jù)集的深度學(xué)習(xí)訓(xùn)練而獲得。

另外,來(lái)自麥克風(fēng)的語(yǔ)音輸入首先會(huì)被傳送至文本模塊,進(jìn)行轉(zhuǎn)化轉(zhuǎn)換處理。該模塊采用的是Google的STT服務(wù)。

情緒分析組件使用從STT服務(wù)接收到的文本來(lái)評(píng)估文本的極性值(正-中性-負(fù)),然后通過(guò)SO-CAL情感分析器在NRC-Canada詞典上進(jìn)行了重新訓(xùn)練,最后將文本發(fā)送至決策組件生成對(duì)話響應(yīng)。整個(gè)處理過(guò)程會(huì)持續(xù)到對(duì)方發(fā)送語(yǔ)音結(jié)束為止。

行為控制器模塊:負(fù)責(zé)在對(duì)話循環(huán)中,生成同理心和具有目標(biāo)導(dǎo)向的語(yǔ)言/非語(yǔ)言響應(yīng)。 在收聽(tīng)階段,3D虛擬人像會(huì)產(chǎn)生相應(yīng)的情感匹配和反向傳播行為。情感匹配是通過(guò)移情機(jī)制對(duì)用戶(hù)面部表情的選擇而實(shí)現(xiàn)的。而在交談中通過(guò)檢測(cè)到暫停觸發(fā)的點(diǎn)頭行為來(lái)創(chuàng)建反向傳播,這兩種行為的集合,最終生成了獲取情感的聆聽(tīng)行為。

當(dāng)對(duì)話結(jié)束后,從STT引擎接收到的文本信息會(huì)與用戶(hù)的總體情感一起傳遞至對(duì)話管理器(Dialogue Manager),并最終發(fā)送到移情機(jī)制(e Empathy Mechanisms)組件。 DM的目標(biāo)是完成Big-5人格問(wèn)卷識(shí)別的個(gè)性類(lèi)別。 EM的目標(biāo)生成對(duì)應(yīng)類(lèi)別的情感響應(yīng)。

行為管理模塊:用于創(chuàng)建自然的對(duì)話行為。M-Path在對(duì)話的所有狀態(tài)下連續(xù)生成非語(yǔ)言或非語(yǔ)言行為,如面部表情,身體姿勢(shì)、手勢(shì)及嘴唇移動(dòng)會(huì)與語(yǔ)音輸出同步完成,并作為行為標(biāo)記語(yǔ)言(Behavior Markup Language)消息發(fā)送到Smartbody角色動(dòng)畫(huà)平臺(tái)以顯示生成的行為。

第二階段生成風(fēng)格化肖像,這部分的處理分為三個(gè)步驟。首先主要是運(yùn)用AI工具對(duì)人像進(jìn)行預(yù)處理,包括圖像背景分割,調(diào)整人像的光和色彩的平衡。

然后將預(yù)處理的圖像輸入至mDD系統(tǒng)模型進(jìn)行深度訓(xùn)練,這里借用的是Google的Deep Dream模型,基于本次研究特性進(jìn)行了部分調(diào)整,因此在這里成為mDD(ModifiedDeep Dream)。它所使用的數(shù)據(jù)集收集了來(lái)自3000位藝術(shù)家的160,000張帶有標(biāo)簽和分類(lèi)的畫(huà)作,總大小為67 GB。

最后,ePainterly系統(tǒng)結(jié)合Deep Style來(lái)處理人像表面紋理以及非真實(shí)感的渲染(NPR)技術(shù),例如粒子系統(tǒng),調(diào)色板操縱和筆觸引擎技術(shù)。這個(gè)不斷迭代的過(guò)程將完成最終的肖像風(fēng)格。其中ePainterly模塊是講點(diǎn)繪畫(huà)系統(tǒng)Painterly的擴(kuò)展。

這部分NPR渲染在很大程度上減少了mDD輸出圖像時(shí)產(chǎn)生的噪聲偽影。以下是各個(gè)階段的效果圖:

雖然AI畫(huà)家在捕捉人類(lèi)情感,繪制風(fēng)格化肖像方面表現(xiàn)非常出色,但該研究團(tuán)隊(duì)認(rèn)為它還有很大的擴(kuò)展空間,并表示從情感評(píng)估模型、用戶(hù)個(gè)性分析和互動(dòng)場(chǎng)景三個(gè)方面對(duì)其進(jìn)行優(yōu)化。

-

AI

+關(guān)注

關(guān)注

91文章

39810瀏覽量

301479 -

人臉識(shí)別

+關(guān)注

關(guān)注

77文章

4127瀏覽量

88494 -

3D打印

+關(guān)注

關(guān)注

28文章

3638瀏覽量

118084

發(fā)布評(píng)論請(qǐng)先 登錄

AI玩具:以多輪對(duì)話、情感陪伴等為賣(mài)點(diǎn),多款方案優(yōu)化角逐

MWC 2026風(fēng)向標(biāo):AI硬件告別“卷”參數(shù),模塊化與情感交互將破局

光伏板運(yùn)維的“裂痕捕手”:光伏板隱裂快速檢測(cè)儀

廣和通發(fā)布端側(cè)情感對(duì)話大模型FiboEmo-LLM

【「AI芯片:科技探索與AGI愿景」閱讀體驗(yàn)】+AI芯片到AGI芯片

【「AI芯片:科技探索與AGI愿景」閱讀體驗(yàn)】+AI的科學(xué)應(yīng)用

Arm首席執(zhí)行官Rene Haas入選《時(shí)代》周刊全球AI百大人物

小馬智行彭軍入選2025年全球AI領(lǐng)域百大影響力人物

【Sipeed MaixCAM Pro開(kāi)發(fā)板試用體驗(yàn)】基于MaixCAM-Pro的AI生成圖像鑒別系統(tǒng)

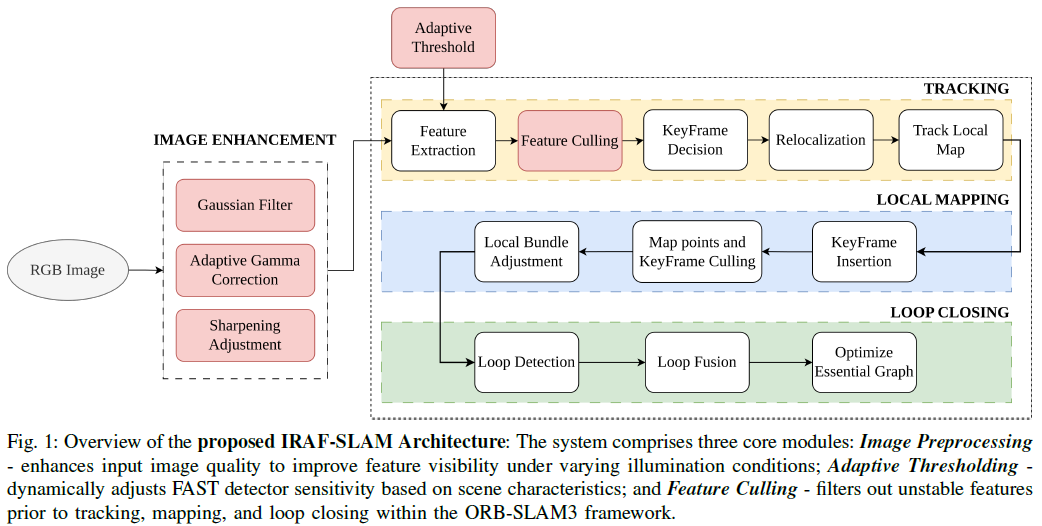

具備光照魯棒和自適應(yīng)特征剔除的VSLAM前端框架

【BPI-CanMV-K230D-Zero開(kāi)發(fā)板體驗(yàn)】視頻會(huì)議場(chǎng)景下的 AI 應(yīng)用(電子云臺(tái) EPTZ、人像居中 / 追蹤、畫(huà)中畫(huà))

AI 重塑玩具產(chǎn)業(yè),從功能疊加到情感共生的進(jìn)化之路?

【「零基礎(chǔ)開(kāi)發(fā)AI Agent」閱讀體驗(yàn)】+讀《零基礎(chǔ)開(kāi)發(fā)AI Agent》掌握扣子平臺(tái)開(kāi)發(fā)智能體方法

你失去工作不是因?yàn)?b class='flag-5'>AI,而是因?yàn)槭褂?b class='flag-5'>AI的人

AI畫(huà)家化身“心靈捕手”,繪制具備情感特征的人物肖像

AI畫(huà)家化身“心靈捕手”,繪制具備情感特征的人物肖像

評(píng)論