隨著人工智能漸漸落地,人工智能對于算力的需求逐漸增強。本輪人工智能熱潮背后的基礎是大數據和神經網絡,需要海量的數據去訓練復雜的神經網絡,而訓練完成后的神經網絡也較為復雜,執行神經網絡的推理操作相對于其他基于邏輯規則等智能方案需要更大的計算力。因此,算力成為了人工智能背后的基礎資源,而算力的提升則離不開芯片的支持。近日,高通、寒武紀、依圖等來自不同背景的明星公司都發布了其用于服務器端的人工智能芯片方案,再加上谷歌、亞馬遜、Intel、Nvidia等早已在服務器人工智能芯片領域押注的大公司,我們看到了服務器人工智能芯片的熱潮。

服務器AI芯片市場已經有明確需求

人工智能計算一般可以分為兩類,即訓練和推理。訓練是指使用收集到的大量數據去優化神經網絡的各項參數,從而能實現最優的精確度。推理則是在訓練好的神經網絡上將輸入數據在各層網絡之間做正向傳遞去求得輸出。訓練任務和推理任務執行的計算對于計算精度和內存訪問的模式都有所不同,因此芯片上往往需要不同的優化。

人工智能芯片根據應用場合也可以分為三個種類:服務器、邊緣計算、終端。服務器人工智能芯片主要部署在數據中心的服務器中,執行訓練和/或推理任務。服務器人工智能芯片對于芯片的首要需求就是單芯片算力(目前的主流算力在100TOPS級別),其次才會去考慮功耗和成本。邊緣計算是指部署在更接近數據源頭的服務器上執行的計算,以推理計算為主,典型應用場景包括在自動駕駛汽車上執行自動駕駛算法、在智能銷售領域無人店中執行監控和結賬操作等等。在邊緣計算中,芯片的功耗和成本相對于云端有更嚴格的限制,而算力則還是多多益善(10TOPS以上)。終端計算則是指直接部署在手機、智能音箱等終端設備上人工智能計算,由于使用電池供電,其對于芯片的首要需求是能效比(1TOPS/W數量級),需要使用盡可能低的能量消耗去完成人工智能計算以保證電池壽命。雖然終端計算對于算力的要求較低(0.1-1TOPS數量級),但是其功耗約束很強,可用的功耗在1W以下,甚至可以低至幾十毫瓦級別,同時終端設備對于成本也很敏感。

目前上述三個人工智能應用場景中,邊緣計算尚處于概念驗證階段,預計未來幾年隨著5G和無人駕駛、機器人、智能零售等概念的興起會出現一批相關芯片公司,但是在今天市場規模還較小。終端人工智能計算目前已經得到初步驗證,手機等智能設備都在爭相加入人工智能專用處理模塊,但是由于其市場對于成本的敏感性,我們預期未來人工智能在終端設備上的形態會以SoC上的IP模塊為主,這也就意味著人工智能要么是由高通、海思等智能設備SoC廠商自研集成到自家的SoC中,要么是由第三方以IP的形式授權給SoC廠商,總體來說該市場的利潤率并不會太高,還是要以量取勝。

相較而言,服務器端人工智能芯片市場目前已經得到了較好的驗證,業務模式和市場規模都已經獲得了認可,利潤率也較高,因此成為了主流芯片公司的必爭之地;而邊緣和終端市場在今天來看還主要是針對未來的前瞻性布局。根據Barclays Research的研究報告,服務器端人工智能市場會在未來三年內快速增長,并預計于2021年達到100億美元的規模;而終端和邊緣計算市場則將在三年后才開始真正落地。所以,我們看到了巨頭紛紛在今年加碼服務器端人工智能芯片。

進入服務器AI芯片市場的幾種打法

目前來看,做云端AI芯片的主要有兩種廠商,一種是芯片公司,另一種是互聯網公司,包括AI公司(如依圖)這樣的“新物種”。

對于芯片公司來說,服務器AI市場的客戶往往比較分散,而且每個廠商都有自己獨特的訴求,因此需要一家一家談。由于不同的公司有不同的人工智能技術棧,芯片公司需要能兼容不同公司的需求,有時候甚至需要和客戶公司合作開發來確保能滿足需求。同時,芯片公司需要在各大公司的需求中尋找到最大公約數,來確保自己的芯片能進入盡可能多的客戶中。芯片公司可以直接進入終端客戶的服務器中,或者與提供服務器的系統集成商合作,為客戶設計滿足其需求的服務器來完成銷售。例如,中國AI芯片獨角獸寒武紀據悉已經獲得了滴滴、海康威視等商業客戶的直接訂單,同時也與浪潮、聯想和曙光等服務器系統集成商積極合作來完成服務器的訂單。寒武紀于一周前披露的最新思元270芯片使用TSMC 16nm制造,額定功耗75W,其整數計算能力分別為256TOPS(int4)、128TOPS(int8)和64TOPS(int4),這樣的設計預計主要針對服務器推理市場,其算力和功耗與Nvidia T4基本相當,基本可以作為Nvidia T4的國產替代,同時寒武紀有位于中國市場離客戶近以及性價比的優勢,因此想必還是能夠拿下大量訂單。另外,寒武紀的思元270還集成了視頻圖像編解碼模塊,估計其找到的客戶“最大公約數”仍然是計算機視覺相關領域,如視頻內容分析、安防等。

除了芯片公司向上進入服務器AI市場外,另一類公司則是互聯網以及AI公司親自入場做芯片,例如谷歌、亞馬遜以及剛發布自研芯片的中國AI獨角獸依圖。傳統來說,互聯網和AI公司主要是服務器和芯片的終端客戶,他們的需求是尋找市面上最合適的硬件來運行自己的應用。然而,當市面上的硬件都無法滿足這些終端客戶的需求時,他們也會親自做滿足自己需求的芯片。

互聯網和AI公司親自做芯片背后的邏輯主要在于建立競爭壁壘。隨著AI的落地以及AI對于算力的強烈需求,硬件已經成為AI背后重要的競爭要素。目前,隨著市場的充分競爭,各大AI巨頭在算法和模型等方面都沒有和彼此拉開很大的差距,于是硬件就成為了差異化競爭的重要因素。當模型和算法差距不大時,是否能使用較低的成本部署AI系統并提供良好的用戶體驗就成了能否拿到用戶訂單的重要因素了。另外,互聯網和AI公司是最清楚自己需求和算法的,因此通過軟硬件協同優化可望能實現最優化的系統設計。

上周依圖公布的求索就是AI公司入場AI芯片的最新動態。求索SoC完全結合依圖的算法做優化,只支持int8操作,主要針對視覺應用,例如人臉識別、車輛檢測、視頻結構化分析等任務。配合依圖的算法,使用四塊求索芯片的依圖原子服務器算力和使用八塊Nvidia P4的服務器相當,而體積僅為P4服務器的一半,功耗則低至20%,從而能大大減少部署的難度。更關鍵的是,目前一塊Nvidia P4的市價為2000美元左右,而求索芯片板卡的成本我們預計可以做到100美元以下,因此可以幫助依圖進入更多的客戶。相比使用Nvidia GPU的其他競爭公司,依圖的算法配合自研的芯片確實是一個很強的競爭優勢。

未來服務器AI芯片競爭格局預估

隨著服務器端AI市場的真正落地,越來越多的廠商開始真正投入該市場,Nvidia的壟斷難度也越來越大。如前所述,新進入服務器AI芯片戰場的廠商要么擁有芯片背景,或者是互聯網/AI公司親自做芯片。服務器AI市場的特殊性在于不同垂直應用對于芯片的需求有較大不同,而使用目前的主流芯片架構做一款能兼容大多數應用的芯片往往性能不夠好,因此芯片廠商還是需要認準一些重要的垂直應用,并且在垂直應用中打下站穩腳跟之后再考慮去橫向擴展。對于互聯網/AI公司造芯來說,由于他們對于垂直應用的前景非常清楚,因此主要就是看自研芯片對于競爭壁壘的構建有多少幫助,是否值得投入資金真正做芯片。在設計服務行業越來越成熟的今天,造芯的成本會逐漸降低,因此我們預期看到越來越多的互聯網和AI公司加入自研芯片的行列。因此,服務器AI芯片的競爭格局我們預期在未來幾年會看到Nvidia憑著CUDA生態的優勢仍然占據通用芯片的主流地位,但是其市場份額將會被其他芯片公司和客戶公司慢慢蠶食,同時在云端數據中心FPGA也會占據一部分市場。

服務器AI芯片競爭的變數在于下一代技術。目前馮諾伊曼架構的加速器的架構潛力已經被挖掘得很充分,之后難以再期待數量級上的提升,因此能帶來重大變革的當屬下一代技術。下一代技術還擁有不少不確定性,但是我們也看到了不少新技術擁有巨大的潛力,例如使用光技術做計算的LightIntelligence,可以實現超低延遲超低功耗計算。

-

服務器

+關注

關注

14文章

10256瀏覽量

91517 -

人工智能

+關注

關注

1817文章

50102瀏覽量

265514 -

AI芯片

+關注

關注

17文章

2128瀏覽量

36793

原文標題:為何巨頭紛紛投入服務器AI芯片市場?

文章出處:【微信號:WW_CGQJS,微信公眾號:傳感器技術】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

AI 服務器電源如何迭代升級?

蘋果正研發用于AI服務器的專用芯片

RAKsmart服務器如何賦能AI開發與部署

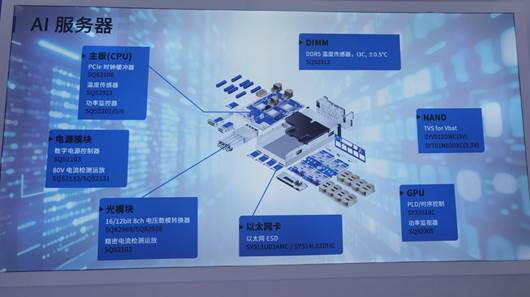

AI服務器硬件攻堅戰,從時鐘緩沖到電容,解決功耗、帶寬、散熱難題

AI 推理服務器都有什么?2025年服務器品牌排行TOP10與選購技巧

RAKsmart服務器如何重塑AI高并發算力格局

服務器AI芯片市場已經有明確需求,進入服務器AI芯片市場的幾種打法

服務器AI芯片市場已經有明確需求,進入服務器AI芯片市場的幾種打法

評論