將強化學習算法應用到現(xiàn)實問題中的一個障礙就是缺少合適的獎勵函數(shù),而設計獎勵函數(shù)又比較困難,因為用戶只能自己理解任務的目標,很難傳達給強化學習智能體。這就引出了智能體和用戶的連接問題(agent alignment problem):我們如何創(chuàng)建一款符合用戶想法的智能體呢?

近日,DeepMind的新論文Scalable agent alignment via reward modeling: a research direction就提出了一種研究方向,本文對該論文進行了概述總結。簡單來說,本次提出的方法依靠獎勵模型的循環(huán)應用,通過連接(align)用戶的目的解決復雜的現(xiàn)實世界問題。以下是論智對原文的詳細編譯:

最近幾年,強化學習在復雜的游戲環(huán)境中得到了不錯的表現(xiàn),例如雅達利游戲、圍棋、象棋、Dota 2、星際爭霸II等等,AI智能體在這些復雜領域的表現(xiàn)甚至超過了人類水平。游戲是開發(fā)和測試機器學習算法的理想平臺,其中有很多挑戰(zhàn)性的任務,需要具備多種認知能力才能完成。機器學習研究者可以在云端同時運行數(shù)千個模擬實驗,生成足夠多的訓練數(shù)據(jù)供系統(tǒng)學習。

重要的是,游戲通常有清晰的目標,還有可以表現(xiàn)距離目標遠近的分數(shù)。分數(shù)能為強化學習智能體提供有用的獎勵函數(shù),當選擇了正確的算法或架構時,能讓我們獲得快速的反饋。

智能體的連接問題

總的來說,AI的目標是不斷具備解決現(xiàn)實中復雜問題的能力,從而造福人類。但是現(xiàn)實生活中的任務并沒有內置的獎勵函數(shù)。這樣一來,智能體在任務中的表現(xiàn)就無法輕易地定義,所以我們需要一種好方法提供反饋,讓智能體確切地了解我們想要什么,從而幫我們實現(xiàn)目標。換句話說,我們想用人類的反饋訓練AI系統(tǒng),用這種方法將系統(tǒng)的行為和我們的目標聯(lián)系在一起。針對這一目標,于是”智能體的連接“問題的定義如下:

如何創(chuàng)建能符合人類目標的智能體?

連接問題可以在強化學習框架中進行,只不過其中要接受數(shù)字類型的獎勵信號,智能體可以通過交互協(xié)議和用戶進行互動,從而讓用戶將他們的想法傳遞給智能體。該協(xié)議有多種形式,用戶可以提供示范、偏好、最佳行為或者提供獎勵函數(shù)。解決智能體連接問題的一種方法就是根據(jù)用戶目標作出動作。

DeepMind的新論文對這一問題指明了研究方向。基于此前的AI安全性問題和各種相關研究,我們設想了這些研究成果能為智能體的連接問題做出哪些幫助。這為了解如何與用戶互動打開了新的大門,即從他們的反饋中學習并預測偏好,這些都是更復雜、更抽象的話題,需要用超越人類水平的方式去理解。

用獎勵建模進行連接

研究方向的重點是基于獎勵建模:我們用用戶反饋訓練了一個獎勵模型,來捕捉他們的意圖。同時,我們還訓練了一個帶有強化學習的策略,用來讓獎勵最大化。換句話說,我們將“學習做什么”從“學習怎么做”中分離出來。

獎勵建模圖示

例如,在之前的研究中我們教智能體如何根據(jù)用戶的要求進行后空翻、根據(jù)目標狀態(tài)放置目標物體、根據(jù)用戶選擇和專業(yè)玩家示范玩雅達利游戲。未來,我們想設計的算法能夠學習適應用戶提供反饋的方式(例如使用自然語言)。

擴大規(guī)模

長期來看,我們會擴大獎勵建模的規(guī)模,將其應用于人類難以評估的領域。為了做到這一點,我們需要增強用戶衡量輸出的能力。我們討論了如何循環(huán)應用獎勵建模:我們可以用獎勵建模訓練智能體,幫助用戶進行評估。如果評估過程比做出動作更容易,我們就能從簡單的任務中轉移到更復雜的任務上。這也可以看作是迭代增強的例子。

循環(huán)獎勵建模圖示

例如,假設我們現(xiàn)在想訓練智能體設計一款計算機芯片,為了檢測一款芯片設計,我們訓練了其他帶有獎勵模型的智能體,模擬測試芯片的性能,計算熱損耗、估計芯片的使用壽命、尋找安全漏洞等等。最后,智能體的輸出能讓用戶訓練出符合要求的智能體。盡管每個智能體都要解決很多比當前機器學習系統(tǒng)更難的任務,但這些任務會比設計芯片要簡單。因為設計一款計算機芯片,你要理解每種評估任務,但是反之則不是必要的。在這種情況下,循環(huán)獎勵模型可以讓我們的智能體解決更復雜的任務,同時保留和用戶目標之間的聯(lián)系。

研究挑戰(zhàn)

想將獎勵建模擴大到復雜問題中,我們會遇到一些挑戰(zhàn)。下圖列出了五種主要問題以及可能的解決方法,論文對這些問題進行了深入的講解。

這也是智能體匹配問題中最后一個重要因素:當將智能體應用在現(xiàn)實世界中時,我們需要向用戶充分證明我們的智能體的確和用戶目標完全匹配。論文中提到了五種不同的方法,幫助用戶增加對智能體的信心:設計選擇、測試、可解釋性、正式驗證以及理論保證。

結語

雖然我們相信循環(huán)獎勵建模是訓練相連智能體的正確方向,但目前我們還不知道它擴展的情況如何。幸運的是,我們還有一些與智能體連接相關的研究方向:

模仿學習

短期強化學習

反向強化學習

協(xié)作反向強化學習

迭代增強

辯論

智能體基礎

論文中對它們的相似之處和不同點都做了更深介紹。

正如對抗輸入對計算機視覺系統(tǒng)的穩(wěn)健性一樣,在復雜的顯示領域中部署機器學習系統(tǒng)也是未來需要面對的難題。盡管我們會在擴展獎勵建模時遇到挑戰(zhàn),但這些挑戰(zhàn)是可以從中獲取進展的具體技術性問題。從這個意義上講,我們的研究方向已經(jīng)準備就緒,可以開展深層強化學習智能體的實證研究了。

-

機器學習

+關注

關注

66文章

8554瀏覽量

136979 -

智能體

+關注

關注

1文章

477瀏覽量

11608 -

強化學習

+關注

關注

4文章

270瀏覽量

11970

原文標題:如何讓智能體了解用戶意圖?DeepMind提出獎勵建模

文章出處:【微信號:jqr_AI,微信公眾號:論智】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

【「零基礎開發(fā)AI Agent」閱讀體驗】操作實戰(zhàn),開發(fā)一個編程助手智能體

小藝開放平臺快速創(chuàng)建鴻蒙智能體

小藝智能體調試與預覽---真機測試

開發(fā)智能體配置-隱私協(xié)議服務

開發(fā)智能體配置-內容合規(guī)

開發(fā)智能體調試與預覽---真機測試

鴻蒙智能體上/下架、升級流程介紹

如何讓AI符合人類的意圖?如何創(chuàng)建符合用戶意圖的智能體?

人工智能的倫理智能體應用及相關研究

聯(lián)匯科技發(fā)布自主智能體 OmBot 歐姆智能體及 OmBot OS 操作系統(tǒng)

AI智能體逼真模擬人類行為

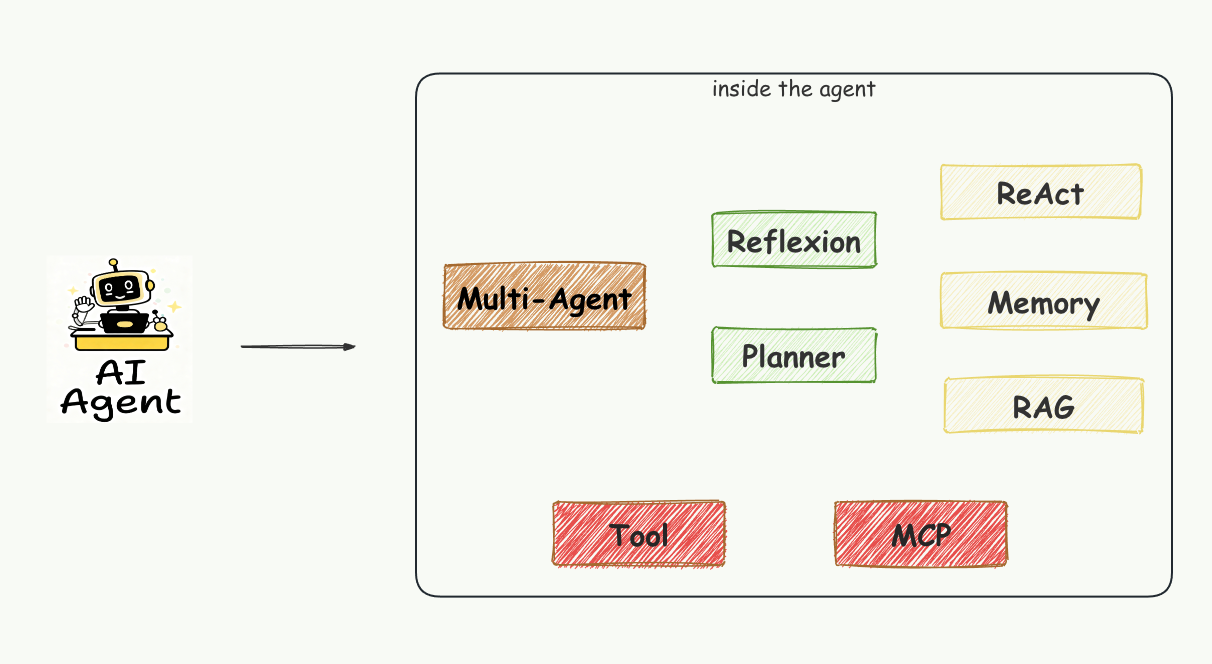

多智能體設計模式和智能體框架,你會了么?

智能體的連接問題,如何創(chuàng)建能符合人類目標的智能體?

智能體的連接問題,如何創(chuàng)建能符合人類目標的智能體?

評論