1 月 18 日,據TradeSource Consulting (TSRC)發布的最新研究預測,到2024年為止,全球AI Server(包括AI Training與AI Inference)預計將超過160萬臺,較上一年度增長約40%。

該公司進一步指出,自2025年起,AI PC將會逐漸普及。他們預期,到了2024年下半段,將會有廠商推出計算能力達40TOPS的AI PC,同時,英特爾計劃在2024年年末之前推出Lunar Lake處理器,這將有助于推動AI PC的全面拓展。

TSRC分析認為,AI PC商業化主要受到兩大因素驅動。首先,終端應用的需求起著重要作用。微軟將AI功能融入Windows和Office等知名軟件中,促使AI PC逐漸發展壯大。其次,英特爾借由推動CPU+GPU+NPU架構,刺激了各類終端AI應用的豐富性。

在其他芯片領域,高通于去年年底推出了Snapdragon X Elite平臺,具有45TOPS的計算能力,能夠滿足AI PC的需求。此外,AMD的Ryzen 8000系列(Strix Point)和英特爾的Meteor Lake也都被廣泛看好,前者預計擁有34TOPS的算力,能實際應用于AI PC。另一方面,AMD的Lunar Lake預計將于明年推出,有望超過40TOPS。

需要特別提及的是,這場圍繞AI PC展開的爭奪戰,不僅關乎X86及Arm兩大CPU陣營在Edge AI市場的位置,還涉及高通、英特爾以及AMD的未來發展。

同時,如戴爾、惠普、聯想、華碩、宏碁這些OEM巨頭預計將在2024年逐步推出現階段搭載高通CPU的新款PC機型,這無疑將給X86陣營帶來新的壓力。

就內存規格而言,根據微軟設定的AI PC標準,建議至少配置16GB內存。長遠來看,TSRC預判AI PC將可能促進PC DRAM需求增長。然而,受消費者換機周期影響,AI PC對PC DRAM位元需求可能會進一步提高。

此外,為了滿足NPU40TOPS所需的CPU,微軟制定了三種選擇方案,它們分別使用LPDD5x以便提升傳輸速度。目前的主流選擇通常是DDR SO-DIMM模組,但由于DDR5的傳輸速率(4800-5600Mbps)相對較低,無法滿足AI PC龐大的數據處理需求。相比之下,LPDDR5x的傳輸速率更佳,能夠提供7500-8533Mbps的高速傳輸,從而更好地支持AI PC接收并處理大量的語言指令。

-

微軟

+關注

關注

4文章

6741瀏覽量

107891 -

英特爾

+關注

關注

61文章

10302瀏覽量

180538 -

PC

+關注

關注

9文章

2167瀏覽量

159356 -

AI

+關注

關注

91文章

39866瀏覽量

301510 -

AI PC

+關注

關注

0文章

142瀏覽量

724

發布評論請先 登錄

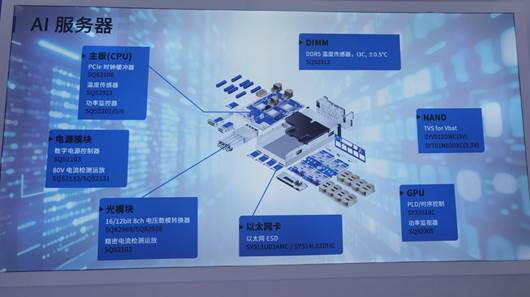

羅姆強勢入局AI服務器800VDC電源方案 原創

對話|AI服務器電源對磁性元件提出的新需求

睿海光電800G光模塊助力全球AI基建升級

加速AI未來,睿海光電800G OSFP光模塊重構數據中心互聯標準

繼HBM之后,英偉達帶火又一AI內存模組!顛覆AI服務器與PC

AI PC爆發年!2025出貨量將破億,科技巨頭引領產業變革

AI 服務器電源如何迭代升級?

【「零基礎開發AI Agent」閱讀體驗】+ 入門篇學習

AI 推理服務器都有什么?2025年服務器品牌排行TOP10與選購技巧

薩瑞微電子SiC 和 GaN賦能AI服務器電源系統

預計2024年全球AI服務器將達160萬臺,AI PC逐步普及

預計2024年全球AI服務器將達160萬臺,AI PC逐步普及

評論